Entre algoritmos e a transformação do ambiente informativo

Apesar de nunca termos tido tanto acesso à informação, compreender o que realmente se passa no mundo tornou-se mais difícil. Entre algoritmos, redacções em declínio e a proliferação da inteligência artificial (IA), o ambiente informativo atravessa uma transformação profunda.

Nas redes sociais, o consumo de notícias deixou, em grande medida, de ser activo. “As pessoas consomem cada vez mais notícias através de feeds contínuos, sem as procurarem activamente”, refere o Instituto Poynter. Um fenómeno que, segundo o artigo, “tem um efeito profundo na forma como as pessoas se mantêm informadas”. Neste contexto, até os próprios factos parecem perder credibilidade.

A crise económica do jornalismo agrava o problema. Em vastas regiões, sobretudo na América Latina, surgem os chamados “desertos informativos”. Um estudo da Fundación Gabo indica que “pelo menos 30% dos territórios analisados qualificam-se como desertos informativos”, deixando comunidades inteiras sem cobertura jornalística local.

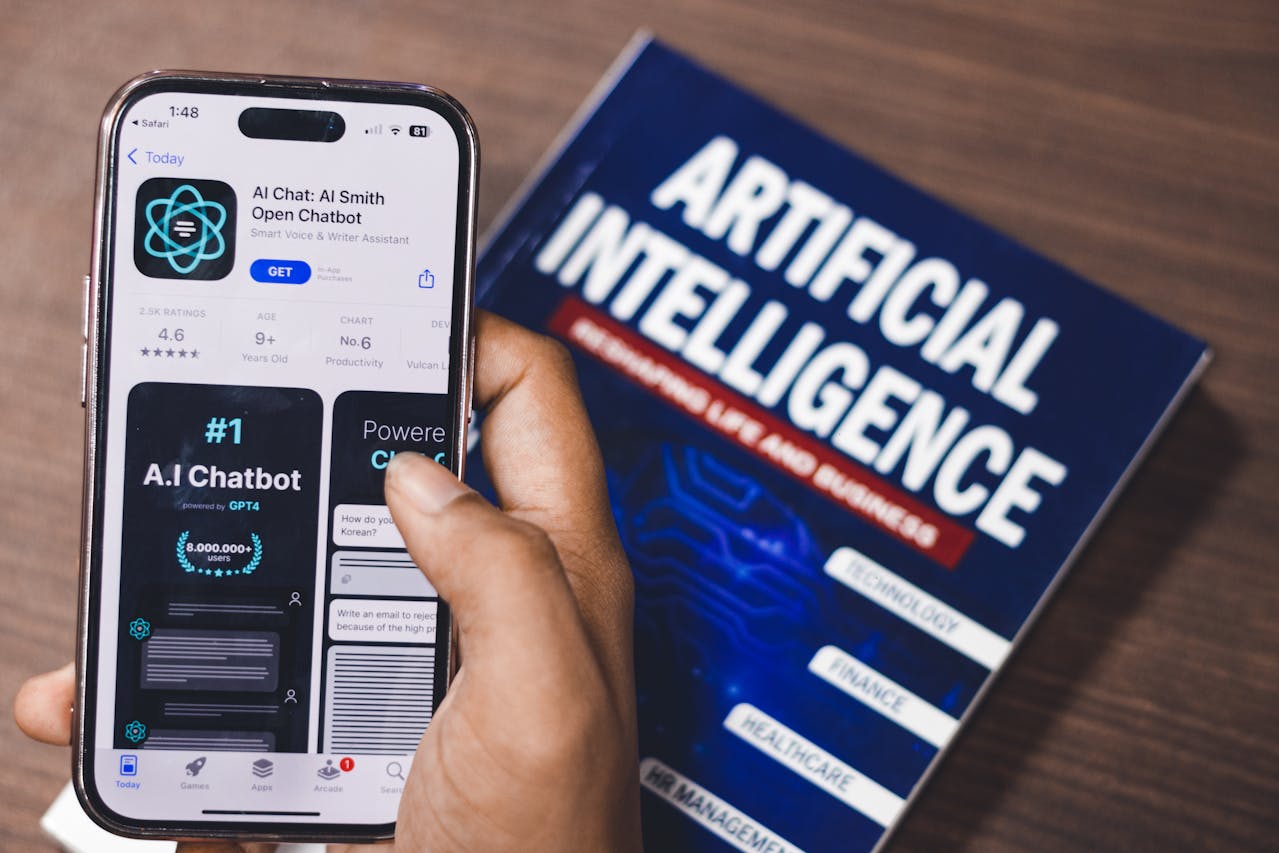

É neste cenário que a IA emerge como um novo factor de perturbação. Especialistas identificam três formas principais pelas quais esta tecnologia está a dificultar o acesso a informação fiável:

Desinformação amplificada

A primeira é também a mais visível: o uso deliberado da IA para desinformar. “Durante o ciclo noticioso em torno da captura de Nicolás Maduro, imagens geradas por IA dele algemado espalharam-se amplamente antes de surgirem provas verificadas.” O ruído informativo é, assim, uma realidade.

Mais alarmante ainda é o envolvimento de organizações criminosas. “Há indícios de que cartéis estão a explorar estas ferramentas para manipular narrativas”, incluindo a criação de imagens destinadas a exagerar cenários de violência.

A motivação não é apenas política. “Os esquemas fraudulentos com vídeos falsos de figuras públicas aumentaram drasticamente”, impulsionados por promessas de investimento que nunca existiram.

Chatbots como fontes de erro

A segunda transformação reside no recurso crescente a chatbots como fontes de informação. Embora possam democratizar o acesso ao conhecimento, estes sistemas apresentam falhas críticas.

“Um sistema que fornece respostas erradas 5% das vezes não parece muito mau”, admitem analistas. “Mas se não soubermos identificar quais são esses 5%, então não é útil.” Na prática, os erros (frequentemente designados como “alucinações”) são difíceis de detectar e podem induzir em erro mesmo os utilizadores mais atentos.

A erosão da prova

A terceira e mais profunda mudança prende-se com a própria natureza da evidência. Se antes imagens e vídeos já podiam ser manipulados, hoje essa manipulação tornou-se mais fácil e praticamente indistinguível da realidade.

“À medida que o conteúdo sintético inunda os feeds, torna-se cada vez mais difícil confiar no que vemos.” Este fenómeno alimenta o chamado “dividendo do mentiroso”: a possibilidade de rejeitar provas autênticas alegando que foram geradas por IA. “Políticos já negaram gravações de áudio com base nesse argumento.”

Não existem soluções simples

Perante este cenário, não existem respostas fáceis. A multiplicação de vozes nas redes sociais é, em si mesma, uma evolução positiva, mas traz novos desafios.

“As empresas de tecnologia devem ser responsabilizadas pelas externalidades negativas dos seus produtos”, defendem especialistas, sublinhando que decisões tomadas por poucas plataformas têm moldado o debate público sem escrutínio suficiente.

Persistem questões fundamentais: “Que salvaguardas existem no treino dos modelos? Como evitar campanhas coordenadas de influência?” Mas a responsabilidade não é apenas institucional. A sociedade civil tem igualmente um papel crucial.

“A literacia mediática é mais importante do que nunca”, afirmam organizações de verificação de factos. Iniciativas educativas, campanhas públicas e recursos para professores são algumas das estratégias adoptadas para capacitar cidadãos.

Apesar dos avanços tecnológicos, existe o consenso de que “o processo de verificação de factos continua a ser fundamentalmente humano.” Máquinas podem auxiliar, mas não substituem o discernimento, o contexto e a capacidade crítica dos verificadores.

(Créditos da imagem: