Quem controla as ferramentas de IA usadas pelos jornalistas

Muitas das empresas proprietárias das ferramentas de inteligência artificial (IA) usadas nas redacções — para verificar factos, gerar conteúdos, agregar notícias e outros fins — não são transparentes quanto aos seus proprietários ou dados financeiros.

Os resultados são de um estudo recente do Media and Journalism Research Center (MJRC) que mapeou estas informações e a influência que as estruturas empresariais de IA podem ter no trabalho jornalístico.

“Para manter a integridade do jornalismo na era da IA, é essencial perceber quem tem interesse nestas empresas de IA e como a IA está a ser usada pelos media”, lê-se no sumário executivo do relatório.

Este conhecimento “assegurará a protecção dos consumidores, da democracia e da verdade”, continua.

O estudo inclui a pesquisa de 100 ferramentas de IA usadas nas redacções.

Foram avaliadas informações como os proprietários das empresas, localização da sede, investidores e volume de financiamento, num total de 12 critérios principais.

Os resultados do estudo

- Apenas um terço das empresas avaliadas têm níveis de transparência considerados “adequados”, disponibilizando informação sobre 9 dos 12 critérios pesquisados.

- Por seu turno, 42% das empresas foram classificadas como “não transparentes”, ou seja, têm disponível informação apenas sobre três ou menos critérios.

- A maioria das ferramentas de IA estudadas (74 em 100) tem disponível informação sobre a localização da empresa detentora do produto — destas, 47% estão sediadas na América do Norte (43% nos EUA), 19% na Europa, 5% na Ásia e 3% no Médio Oriente.

“Se a maior parte dos dados usados para construir e treinar estas ferramentas de IA vem de fontes ocidentais, isto tem implicações para os jornalistas que trabalham no Sul Global e que usam estes produtos”, considera Sydney Martin, autora do estudo, citada pelo Reuters Institute.

Para Sydney Martin, a desadequação cultural das ferramentas de IA pode prejudicar a forma como é reportada a realidade daqueles países. - Quase um quarto das empresas (24%) partilha informação sobre as suas receitas.

- O volume de financiamento é revelado por 43% das empresas. Estes dados são relevantes porque “as pessoas que pagam aos programadores informáticos também controlam, até certo ponto, a verdade e a percepção do público sobre a realidade”, explica a autora do estudo.

O relatório inclui, ainda, um estudo de caso sobre a Get Clarity, classificada como “não transparente” pela pesquisa. A Get Clarity é uma ferramenta de detecção de conteúdos deep fake cujo CEO já trabalhou para as forças armadas israelitas, pelo que, por exemplo, a verificação de dados relativos aos conflito Israel-Hamas pode estar comprometida.

Na página de apresentação do estudo, está disponível uma base de dados completa com a informação sobre as ferramentas de IA avaliadas, as empresas proprietárias e restantes critérios aferidos.

Com a cor verde encontram-se os casos com níveis “adequados” de transparência; a amarelo as ferramentas consideradas “um pouco” transparentes; e a vermelho as empresas “não transparentes”.

Sydney Martin, responsável pelo estudo, desafia os jornalistas a serem mais críticos no usa das ferramentas de IA: “Perguntem-se sobre a origem da informação e se vai influenciar o vosso jornalismo.”

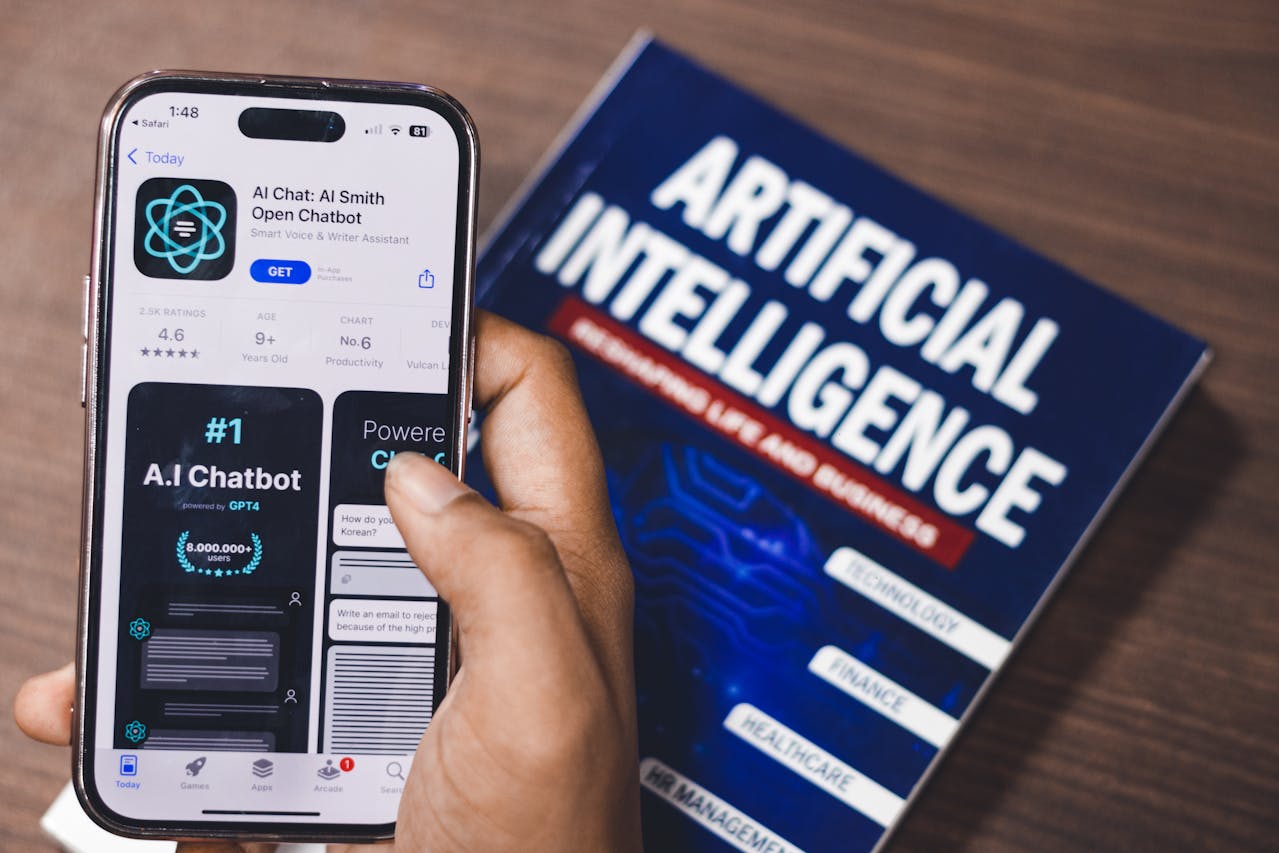

(Créditos da fotografia: Fatos Bytyqi no Unsplash)