Definir princípios éticos para uso da inteligência artificial nas redacções

O instituto Poynter acredita que é importante definir os princípios éticos para o uso da inteligência artificial (IA) antes de avançar no recurso a estas inovações tecnológicas, refere num artigo publicado no final de Março.

Para isso, criou um documento-modelo em que sistematiza algumas orientações éticas e políticas para o uso da IA, bem como a forma como estas devem ser aplicadas a cada etapa do trabalho.

O Poynter, reconhecida organização sem fins lucrativos dedicada ao desenvolvimento profissional dos jornalistas e à promoção de práticas de excelência, partilha o documento em formato editável, para que todas as redacções o possam usar como ponto de partida para a formulação das suas próprias políticas.

“É uma declaração de valores jornalísticos que fundamenta as experiências com a IA nos princípios de rigor, transparência e confiança do público, seguida por um conjunto de directrizes específicas”, explica o artigo.

O documento propõe uma estrutura e deixa espaços em branco, de maneira que cada redacção adapte o conteúdo à sua realidade. Das secções fazem parte: a pesquisa e recolha de dados, criação de títulos, sumário de parágrafos, recurso a elementos visuais, verificação de factos e redes sociais.

O Poynter adverte que o documento tem de ir sendo revisto e actualizado, uma vez que a evolução destas tecnologias será permanente daqui em diante.

Além disso, o instituto sugere que cada redacção constitua um comité para acompanhar a definição das políticas de utilização da IA e designe um editor ou jornalista sénior para liderar o processo.

Dentro do mesmo espírito, também a Carta de Paris sobre IA e Jornalismo, lançada em Novembro do ano passado e elaborada por uma comissão reunida pelos Repórteres Sem Fronteiras, sugere 10 princípios éticos para orientar o recurso à IA pelos meios de comunicação social.

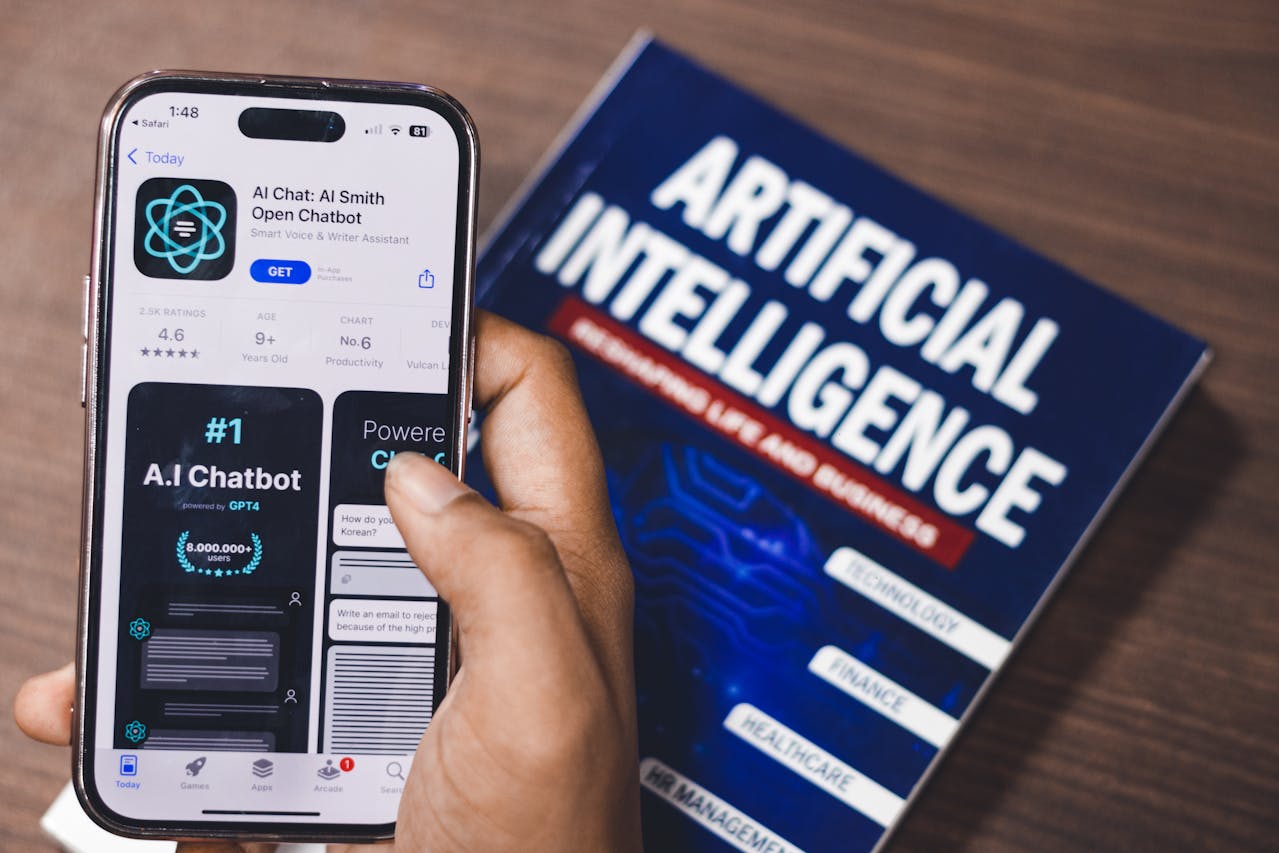

(Créditos da imagem: Mohamed Nohassi no Unsplash)